基于 ollama 下载,部署AI 大模型 提供API 服务

1. 下载 ollama https://ollama.com/

2. 安装完成后,没有操作界面(只能CLI)

3. 检测 安装是否成功 ollama --version

4.常用命令: ollama help

修改默认模型下载位置:

概述:Ollama默认将模型保存在C盘(Windows)、~/.ollama/models(MacOS)或/usr/share/ollama/.ollama/models(Linux)。

为了解决C盘空间不足的问题,可以通过设置环境变量OLLAMA_MODELS来修改模型存储位置。 Windows系统:(系统变量) 设置环境变量OLLAMA_MODES,例如E:\ollama\models。 重启Ollama或PowerShell,使设置生效。 MacOS系统: 通过设置环境变量OLLAMA_MODELS,例如~/ollama/models。 重启Ollama服务。 Linux系统: 创建新目录并设置权限,例如sudo mkdir /path/to/ollama/models。 编辑ollama.service文件,添加环境变量OLLAMA_MODELS。 重启ollama服务。

5.下载模型: https://ollama.com/library

命令 :

ollama run llama3.1

完成后即可问答了

6. 运行模型提供API

6.1 安装代理服务:

创建新的虚拟环境 python -m venv D:/ollama

激活环境:

ollama/Scripts/active.bat

(ollama)> pip install litellm

pip install litellm[proxy](提供代理服务)

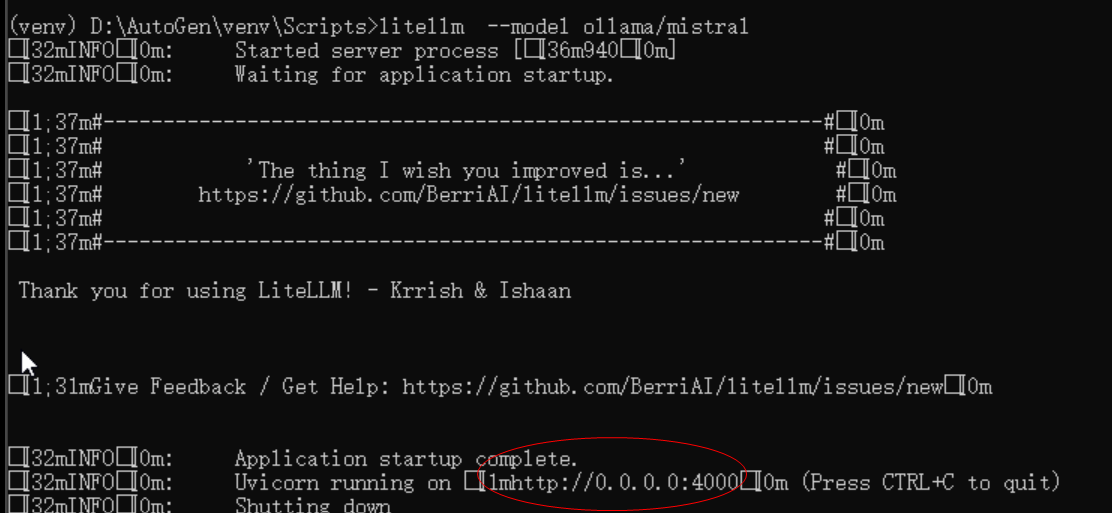

6.2 运行模型,提供服务:

litellm --model ollama/llama3.1